Kausalität ist eines der grundlegendsten Konzepte in der Wissenschaft: Es beschreibt, wie Ursachen zu Wirkungen führen. Wenn du zum Beispiel einen Stein ins Wasser wirfst, verursacht das die entstehenden Wellen. In der Statistik spielt die Kausalität eine besondere Rolle, da wir oft Zusammenhänge zwischen Variablen untersuchen, um herauszufinden, ob und wie eine Veränderung in einer Variablen eine andere beeinflusst.

Was genau ist Kausalität?

Stell dir vor, du möchtest herausfinden, ob etwas Bestimmtes eine bestimmte Wirkung hat. Zum Beispiel: Macht Lernen für eine Prüfung wirklich bessere Noten? Dabei geht es um die Idee von Kausalität, also die Frage: Hat das eine (Lernen) das andere (gute Noten) tatsächlich verursacht?

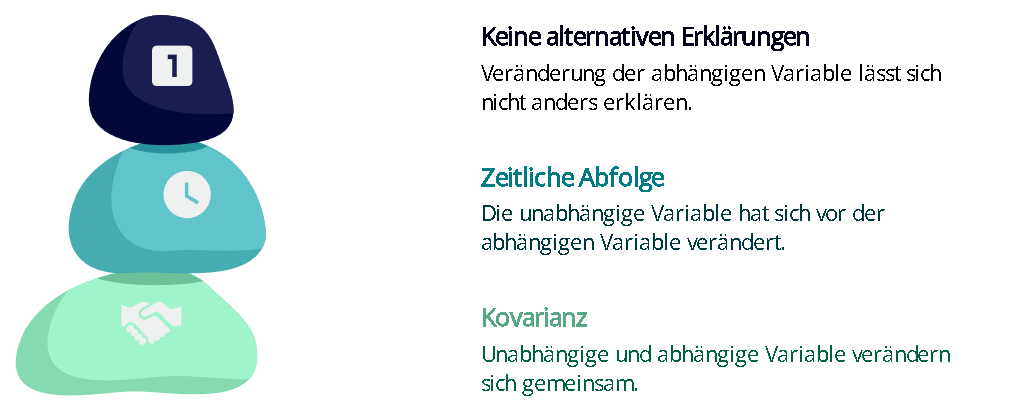

Wir beziehen uns auf drei Merkmale, um Kausalität zu bestimmen:

- Kovarianz: Wenn du mehr lernst (Ursache), musst du sehen können, dass sich deine Noten (Wirkung) verbessern. Es muss einen Zusammenhang geben.

- Zeitliche Abfolge: Das Lernen muss vor der besseren Note passieren, sonst kann es nicht die Ursache sein.

- Keine alternativen Erklärungen: Vielleicht hast du nicht wegen des Lernens, sondern weil dir jemand geholfen hat, bessere Noten bekommen. Um sicher zu sein, dass das Lernen die Ursache ist, müssen wir alle anderen Möglichkeiten ausschließen.

Klingt doch ganz einfach, oder? Aber in der Forschungspraxis ist das leider sehr viel schwerer, diese drei simplen Merkmale direkt zu beweisen. In der Forschung – z. B. in der Psychologie – gibt es nämlich viele Dinge, die wir nicht kontrollieren können. Vielleicht hatte die Person eine gute Nacht oder war einfach motivierter. Es ist unmöglich, alle anderen Ursachen auszuschließen. Deshalb kann man in sozialen Wissenschaften Kausalität oft nur vermuten, aber selten zu 100 % beweisen. Aber: Die Statistik kann uns dabei helfen, zumindest den ersten Punkt zu klären.

Korrelation vs. Kausalität

Es ist wichtig, den Unterschied zwischen Korrelation und Kausalität zu verstehen. Korrelation bedeutet, dass zwei Variablen zusammenhängen – zum Beispiel steigen die Eisverkäufe und die Anzahl der Sonnenbrände im Sommer an. Das heißt aber nicht, dass der Eisverkauf die Sonnenbrände verursacht (Kausalität). In der Statistik müssen wir also vorsichtig sein, um nicht fälschlicherweise Korrelationen als Kausalität zu interpretieren.

Das hat mit den zweiten und dritten Kriterium von oben zu tun. Nur weil eine Kovarianz (bzw. die standardisierte Version davon, die Korrelation) vorliegt, bedeutet das nicht, dass die „richtige“ zeitliche Abfolge gegeben ist oder keine alternative Erklärung vorliegt.

Wie erkennen wir Kausalität in der Forschung?

Kausalitäten zu erkennen kann daher sehr schwierig sein. Die Schwierigkeit kannst du dir mit diesem Gedankenexperiment gut vorstellen: Ein Schalter ist mit einem Gerät verbunden. Wenn du den Schalter drückst, macht das Gerät einen Ton. Hier ist einfach zu sehen, dass alle Merkmale der Kausalität vorhanden sind. Nun manipulieren wir aber die Verbindung zwischen dem Schalter und den Gerät etwas, sodass es nicht immer funktioniert. Manchmal macht das Gerät vielleicht sogar etwas völlig anderes, z.B. wird ein Licht am Gerät angeschalten. Von den Voraussetzungen. unseren drei Kriterien, hat sich nichts geändert. Aber es ist wesentlich schwerer geworden, die Kausalität zu sehen.

Das beste Instrument, das wir in der Forschung haben, um Kausalität nachzuweisen, ist das Experiment. Bei einem Experiment kann ich klar sagen, was zuvor kam (Kriterium 2), weil ich gezielt eine Variable (die unabhängige Variable) manipuliere und messe, wie sich eine andere Variable (die abhängige Variable) verändert. Alternative Erklärungen kann ich durch die Sterilität des Experiments ziemlich gut ausschließen (Kriterium 3). Die Kovarianz (Kriterium 1) bleibt Sache der nachträglichen statistischen Berechnung.

Beispiel: Stell dir vor, du möchtest wissen, ob Koffein die Konzentration verbessert. Du kannst eine Gruppe von Studierenden in zwei Gruppen aufteilen. Eine Gruppe bekommt koffeinhaltigen Kaffee, die andere nicht. Danach testest du ihre Konzentrationsfähigkeit. Wenn die koffeinhaltige Gruppe besser abschneidet, könnte das auf eine kausale Beziehung zwischen Koffein und Konzentration hinweisen. Klar gibt es auch andere Einflussfaktoren , die auf die Konzentrationsfähigkeit wirken, aber im Laborsetting kann ich sie großteils ausschließen (und übrige individuelle Unterschiede werden sich bei genügend großer Fallzahl wohl herausmitteln).

Beispiel in R

Um solche kausalen Zusammenhänge in der Statistik zu untersuchen, verwenden wir oft statistische Modelle. Eine Möglichkeit, dies in R zu machen, ist die Verwendung von linearen Regressionsmodellen, um den Einfluss einer oder mehrerer unabhängiger Variablen auf eine abhängige Variable zu untersuchen.

Hier ein Beispiel, wie du in R eine einfache lineare Regression berechnen kannst:

# Simulierte Daten für Koffeinkonsum und Konzentration

set.seed(123)

Koffein <- c(0, 1, 0, 1, 0, 1, 0, 1)

Konzentration <- c(50, 65, 45, 70, 55, 75, 50, 80)

# Daten als Dataframe

data <- data.frame(Koffein, Konzentration)

# Lineare Regression

modell <- lm(Konzentration ~ Koffein, data = data)

# Zusammenfassung des Modells

summary(modell)

In diesem Beispiel untersuchst du, ob der Koffeinkonsum (Variable Koffein) einen Einfluss auf die Konzentration (Konzentration) hat. Das Ergebnis gibt dir Aufschluss darüber, ob die Beziehung signifikant ist – das bedeutet, ob wir davon ausgehen können, dass Koffein tatsächlich die Konzentration beeinflusst.

Aber was dir sicher nicht entgangen ist: Wir beziehen uns hier nur auf das erste Kriterium. Die anderen beiden müssen wir in diesem Rahmen einfach annehmen. Und es ist eine wichtige Aufgabe des Statistikers bzw. der Statistikerin, kontinuierlich zu hinterfragen, inwiefern die Annahmen zu den Berechungen passen!

Und es ist eine wichtige Aufgabe des Statistikers bzw. der Statistikerin, kontinuierlich zu hinterfragen, inwiefern die Annahmen zu den Berechungen passen!

Fazit

Kausalität hilft uns zu verstehen, warum Dinge passieren. In der Statistik ermöglicht es uns, über bloße Zusammenhänge hinauszugehen und die Ursachen von Phänomenen zu untersuchen. Ob durch Experimente oder statistische Modelle – wenn wir Kausalität richtig verstehen, können wir fundierte Entscheidungen treffen und die Welt um uns herum besser begreifen.